原創 小小戒網

Token是什麼,Token已經成為一種新的基礎的經濟要素和戰略資源。

寫在最開始

AI浪潮奔湧,應用層出不窮,版本迭代日新月異。已經沒有人會懷疑「AI將深入我們每個人的生活」這句話的正確性了。但在所有關於AI的討論中,你一定常聽到一個字—「Token」。那麼, Token到底是什麼?

在電腦和互聯網技術中,Token是一個非常核心的概念。要講清楚Token,我們必須知道Token的三個不同的應用場景:

1.身份驗證中的Token(又稱為訪問令牌)

2.大語言模型(LLM)中的Token(以純文字語言模型為例進行講解,此時Token為文本單位) 【這一應用場景是今天講的重點】

3.區塊鏈與加密貨幣中的Token(代幣)

Token應用程式場景一

我們先來看第一個應用程式場景:身份驗證中的Token(又叫做存取權杖)

這是我們日常上網最常遇到的。當我們登入一個網站或App 後,伺服器會發給你一個Token

例如:

eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJ1c2VySWQiOjEsIm5hbWUiOiJKb2huIER vZSIsImV4cCI6MTcxNjI3MjAwMH0.SflKxwRJSMeKKF2QT4fwpMeJf36POk6yJV_adQssw5c

當然你也可能看到更短的Token ,顯然我給的這個Token比較長。雖然Token有業界通用的格式範式,但是,身份驗證中的存取權杖(Access Token)沒有統一「固定外觀」的。我們不用糾結Token的外觀格式是否統一,就簡單的理解成一串字母符號的構成。

其工作原理為如下:

1. 你輸入帳號密碼登入

2. 伺服器驗證通過,產生一個加密字串(即Token)發給你的瀏覽器或App。

3. 此後你每次要求資料(例如刷新朋友圈),都會自動帶上這個Token。

4. 伺服器看到Token,就知道“哦,這是張三,他已經登入了”,而不需要你每次操作都重新輸密碼。

看了工作原理後,是不是發現身為存取令牌的Token也沒那麼神秘,就是加密的令牌,方便你有權限在登入成功後造訪網站或是APP資訊資源的。Token應用程式場景二

以下我們再來看第二個應用場景:大語言模型(LLM)中的Token(以純文字語言模型為例進行解說)

當我們和deepseek、ChatGPT 或Gemini 對話時,我們需要將我們讓AI幫我們幹的事兒用文字描述給他,這個時候,AI 並不是直接按我們常規意義上的“字”或者“詞”來進行閱讀的。因為計算機是無法直接理解漢字或英文單字的,我們必須先進行文字拆解。拆解一般分為兩種,下面我們就簡單的來說明一下。

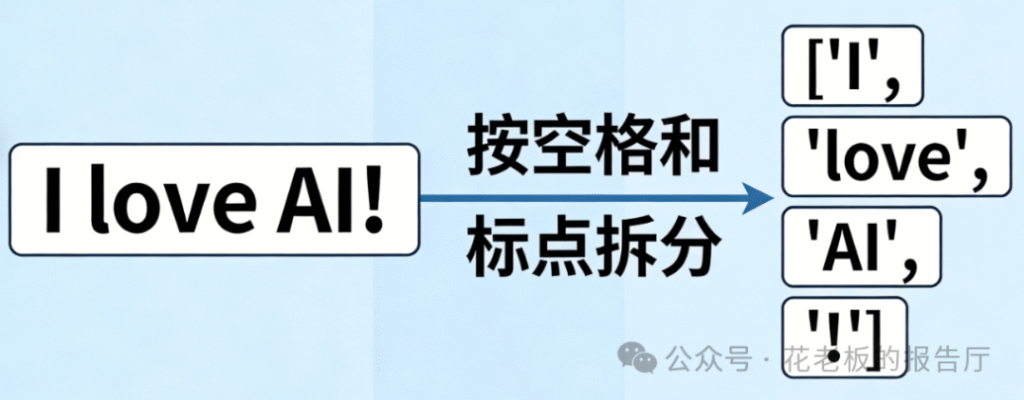

對於英文而言是比較簡單的,因為英文單字通常由空格或標點符號進行分隔的,因此拆解的時候會按照空格和標點符號進行拆分即可。例如:句子”I love AI!”會初步拆成[“I”, “love”, “AI”, “!”]。

當然英文裡面也有比較麻煩的地方,就是一些沒有被收錄的單字或者比較長麻煩的字,為了省事兒和精確,大模型也會按照前後綴的方式進行拆解,比如:unhappily,就可能會被拆解成[“un”, “happi”, “ly”](前綴“un-”、詞根“

下面我們來講一下中文,中文拆起來就比較複雜了,因為中文句子是連續的文字,那麼拆解的任務就變成了按照意思找到正確的詞的邊界。

舉例:我愛人工智慧這句話。我、愛、人、人工、愛人、智慧、人工智慧等等都是存在的且有意義的獨立的詞,甚至「智」這一個字都可以是一個詞。這時候就需要更強大的演算法才能被正確的拆解為[“我”, “愛”, “人工智慧”],這就是分詞技術。這裡就不多講了,第一是因為它比較晦澀,第二是因為它不是本次討論話題的重點,你只需要知道我們需要更複雜的演算法才有可能將中文拆解的合理。

同樣,中文中也有這個字沒被收錄的情況,比如:“烎”,那他就被拆解為更小的數字編碼,如開和火的編碼(註:我這邊只是舉例,實際情況可能有出處,我們只需要知道它被大模型按照自己的規則拆解成更小單位的編碼就可以了)。我們要知道,模型只認識數字,所以,當你輸入一句話的時候,先執行了上面的拆解步驟,被拆解成字的序列(如:[“我”, “愛”, “人工智慧”] ),會進行一個關鍵步驟:查字典,並對應唯一ID。具體方式如下:

大模型有固定的「詞表」(Vocabulary)庫,一般會包含3萬到10萬個Token (也許更多)。每個Token 對應一個唯一的索引數字。說白了就是字典一樣的表,舉例:「我」這個字對應「1500 」這個數字,「愛」這個字對應的是3210這個數字,「物理」對應的是8890這個數字。大家注意了,這個數字是我假設的。總之,我們要理解的是每個字都有自己對應的數字,我們叫他們為Token ID 。下面我舉個例子方便大家理解:

當你輸入「物理是什麼」 這句話時,會先被拆成[“物理”, “是”, “什麼”] 三個獨立的字(也就是Token),我們將這個叫做Token序列。透過剛才的講解,我們了解了,大模型裡面有一個“映射詞表”,每個詞都對應一個唯一的數字ID,這三個詞會透過映射表匹配成[1500, 3210, 8890]這樣的數字串。

這些數字ID只是“字的代號”,電腦能處理但不懂它們的意思—— 接下來會把這些ID送入Embedding層,這一步其實也很容易理解。舉例:「物理」這個詞如果沒有經過Embedding這一層,那麼他就是一個空洞的符號,獨立的和別的詞彙沒有關係的詞,如果「物理」這個詞不能和其他資訊相關聯,那麼我們是不能處理任何任務的。舉例:一個人腦子裡面只有「物理」兩個字,你問他:「物理是什麼?」,他能回答你的問題嗎?很顯然是不能的。大模型也是一樣的。所以,這一步相當的重要,他要讓物理這個字不再是一個空洞的獨立的符號,而是要讓它帶上「數千個維度的特徵」。舉例:物理是獨立的,但是它的特徵有科學、實驗、公式等等。在這,物理的座標會和力學、量子、萬有引力、磁場等靠的非常的近,而離蘋果、跑步等靠的非常的遠。

現在,請大家閉上眼睛,想像一張網,這個網上有很多交織的點,每個點上都有特徵詞,它們是力學、量子、萬有引力、磁場、蘋果、跑步、小狗等等。而「物理」這個詞,此時在你大腦的中心位置,請想像並將這些詞填在這個以「物理」這個詞為中心的網絡中,那麼哪一些詞離它更近,哪一些詞應該離它更遠一些呢。同理,大模型就是這樣,將不同遠近的特徵分佈在「物理」這個詞為中心的網絡中,這樣大模型就可以透過遠近來計算這些詞和詞之間的關係了。

現在這些字從之前雖然有了遠近。但是,它們之間還沒有聯繫,此時大模型就會透過一個叫做「注意力機制」的東西分析詞和詞之間的關係,並將相關的詞聯繫起來。就拿「物理是什麼」這句話來講,分析後就知道「物理」是主語,「什麼」是受詞,「是」將他們連結了起來。此時,模型才會將三個獨立的向量融合在一起,這些詞再也不是孤立的個體,而是透過注意力機制,融合成了一個帶語境的語義整體(在技術上我們叫它「表徵」),至此,模型才讀懂了我們的問題,「物理是什麼」。

這之後,模型就開始進入預測環節,它在數學空間裡進行複雜的運算,根據目前的語境向量,計算出機率最大的下一個Token是什麼。例如:它預測下一個詞是「實驗」或「相互關係」等等。模型會將計算出來的機率向量重新映射回ID (對應的是一個數字),再透過字的映射表轉回人類能懂的文字。這就是我們要的結果了。

下面我透過一個互動流程與Token分解的範例進行進一步的說明:

第一步:您的輸入(Prompt)

你輸入文字“請幫我用貓造句,給出兩個貓的句子”,大模型進行分詞和Token化後:

[“請”, “幫”, “我”, “用”, “貓”, “造”, “句”, “,”, “給予”, “兩個”, “貓”, “的”, “句子”]

所以,輸入的Token數量:13個

第二步:模型輸出(Reponse)

文字:“我特別喜歡小貓” 和“小貓真的是一種非常可愛的生物” 。分詞與Token化(例):

第一句:[“我”, “特別”, “喜歡”, “小貓”]→ 4個Token

連接詞:[“和”]→ 1個Token

第二句:[“小貓”, “真的”, “是”, “一種”, “非常”, “可愛”, “的”, “生物”, “。”]→ 9個Token

輸出Token數量:4 + 1 + 9 = 14個

所以,這次交互的Token總消耗等於輸入Token數+ 輸出Token數= 13 + 14 = 27個Tokens 。順帶補充一句,快取也會隨著對話變長而增加消耗,這就是為什麼對話越久越貴。

在上面這個範例中,您為總共27個文字單元(Tokens)付費。模型在內部將這27個單元(如「請」、「貓」、「小貓」、「可愛」等)分別轉換為27個ID和27組高維向量,並基於它們進行計算,最終產生了您看到的兩個句子。每一個您能讀到的字、字、標點,只要它佔據了模型的一個處理單元,就是一個Token。

Token在轉換為數字前的樣子如下:

輸入端(13個):請| 幫| 我| 用| 貓| 造| 句| , | 給出| 兩個| 貓| 的| 句子

輸出端(14): “ | 我| 特別| 喜歡| 小貓| ” | 和| “ | 小貓| 真的| 是| 一種| 非常| 可愛… (以此類推)

對應轉換為Token ID後的樣子如下:[ 67854, 45212, 2543, 1209, 78431, 3321, 908, 123, 5542, 1029, 78431, 882, 14520, …只有一串機能看懂的機器能看得懂的每個數字通常佔用2 位元組(16位元)或4 位元組(32位元)的儲存空間。

如果你去翻閱大模型的後台日誌,你會看到這27 個Token 的最終消費憑證長這樣:

{"usage": {"prompt_tokens": 13,"completion_tokens": 14,"total_tokens": 27}}

Token應用程式場景三

最後,我們再來看第三種場景應用:區塊鏈與加密貨幣中的Token(代幣)

最後,我們再來看第三種場景應用:區塊鏈與加密貨幣中的Token(代幣)

在區塊鏈中的Token和我們上面的含義完全不同,你可以把它理解為數位世界裡的「憑證」或「數位物品」。用一個簡單的比喻,區塊鏈是一個巨大的、公開的、不可篡改的數位帳本。 Token可以理解成這個帳本上記錄的一行唯一的訊息,用來代表某種東西的所有權或權益。

以上我已經把Token的三個應用場景全部講完了,我相信大家已經明白了。而在AI大模型應用領域中,Token就是計算成本和使用量的基本單位,直接對應您消耗的輸入和輸出文字的總處理量。

掌握了上面我講的,我想大家就知道為什麼說Token已經成為一種新的基礎的經濟要素和戰略資源了。在工業時代,電力是基礎,我們按「度」付費;在資訊時代,流量是基礎,我們按「GB」付費。在人工智慧時代,Token是智慧的最小計量單位。無論是個人創作、企業自動化或國家級的算力競爭,本質上都在消耗和生產Token。誰擁有的Token成本更低、處理Token的效率更高,誰就掌握了「智慧生產力」的定價權。

Token 讓「知識」不再只是書本上的文字,而是變成了可以直接參與生產的「語意資產」。這種資產可以被無限複製、瞬間傳輸並精準呼叫。當我們為27個Token付費時,我們買的不僅僅是文字,而是「被處理過的智慧」。正如我們現在已經不再關注發電機如何轉動了,而只關注電費單,道理是一樣的。我相信,未來社會的所有智力勞動,都會被精準地量化為Token進行流轉。它已經不是簡單的技術名詞了,而是像石油、稀土一樣的戰略資源。

在物理世界,能量守恆是基本定律;但在數位世界,Token是智慧守恆的度量。每單位Token的背後,本質上都是算力、電力和人類知識密度的總和。